ERNIE 4.5 简介

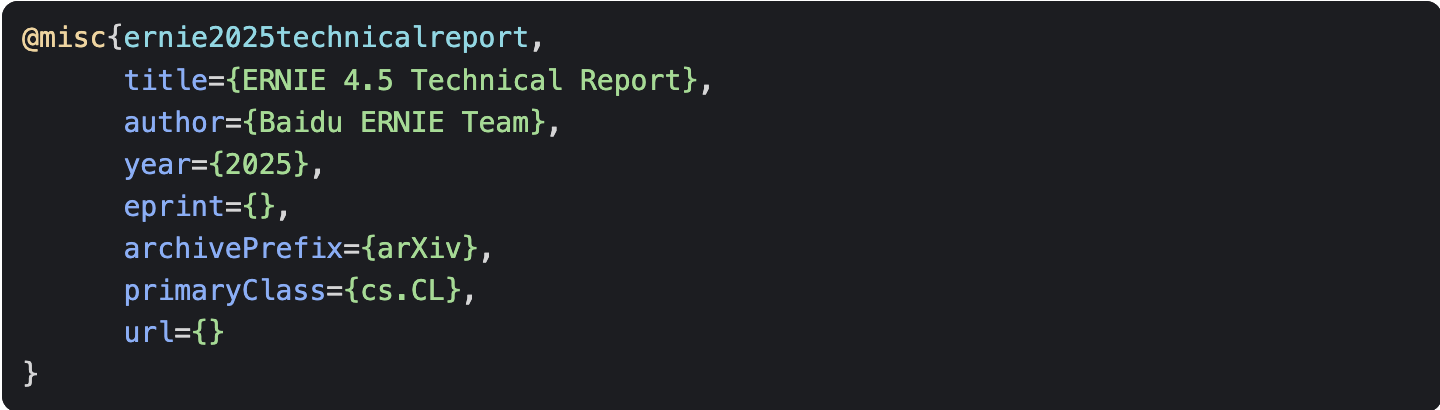

文心4.5系列开源模型共10款,涵盖了激活参数规模分别为47B和3B的混合专家(MoE)模型(最大的模型总参数量为424B),以及0.3B的稠密参数模型。针对 MoE 架构,我们提出了一种创新性的多模态异构模型结构,通过跨模态参数共享机制实现模态间知识融合,同时为各单一模态保留专用参数空间。此架构非常适用于从大语言模型向多模态模型的持续预训练范式,在保持甚至提升文本任务性能的基础上,显著增强多模态理解能力。文心4.5系列模型均使用飞桨深度学习框架进行高效训练、推理和部署。在大语言模型的预训练中,模型FLOPs利用率(MFU)达到47%。我们的模型在多个文本和多模态数据集上取得了 SOTA 的性能,尤其是在指令遵循、世界知识记忆、视觉理解和多模态推理方面。模型权重按照Apache 2.0协议开源,支持开展学术研究和产业应用。此外,基于飞桨提供开源的产业级开发套件,广泛兼容多种芯片,降低后训练和部署门槛。

ERNIE 4.5 技术亮点

ERNIE 4.5 系列模型优越的性能主要来源于以下几个关键技术点:

1.多模态混合专家模型预训练: 文心4.5 通过在文本和视觉两种模态上进行联合训练,更好地捕捉多模态信息中的细微差别,提升在文本生成、图像理解以及多模态推理等任务中的表现。为了让两种模态学习时互相提升,我们提出了一种多模态异构混合专家模型结构,结合了多维旋转位置编码,并且在损失函数计算时,增强了不同专家间的正交性,同时对不同模态间的词元进行平衡优化,达到多模态相互促进提升的目的。

2.高效训练推理框架: 为了支持 文心4.5 模型的高效训练,我们提出了异构混合并行和多层级负载均衡策略。通过节点内专家并行、显存友好的流水线调度、FP8混合精度训练和细粒度重计算等多项技术,显著提升了预训练吞吐。推理方面,我们提出了多专家并行协同量化方法和卷积编码量化算法 ,实现了效果接近无损的4-bit 量化和2-bit 量化。此外,我们还实现了动态角色转换的预填充、解码分离部署技术,可以更充分地利用资源,提升文心4.5 MoE 模型的推理性能。基于飞桨框架,文心4.5 在多种硬件平台均表现出优异的推理性能。

3.针对模态的后训练: 为了满足实际场景的不同要求,我们对预训练模型进行了针对模态的精调。其中,大语言模型针对通用语言理解和生成进行了优化,多模态大模型侧重于视觉语言理解,支持思考和非思考模式。每个模型采用了SFT、DPO或UPO(Unified Preference Optimization,统一偏好优化技术)的多阶段后训练。

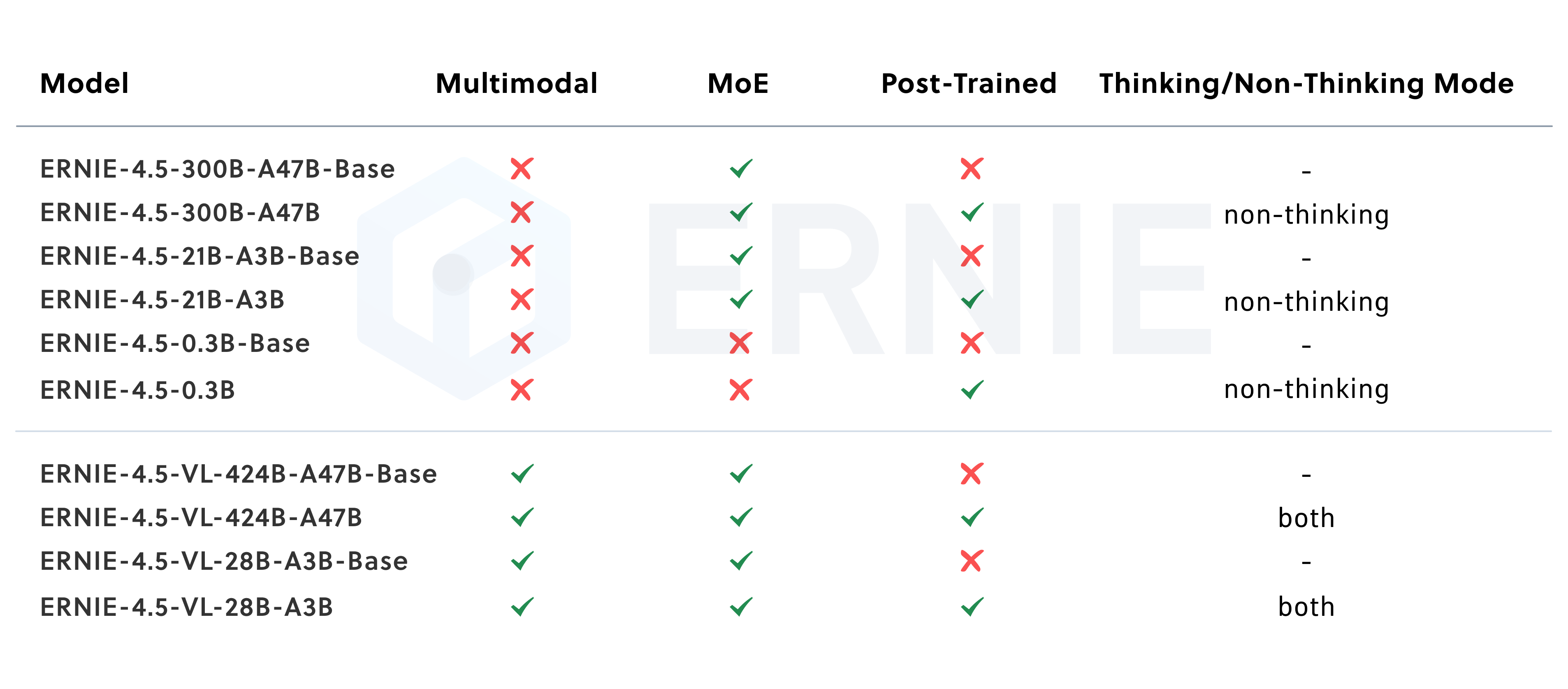

性能和基准测试结果

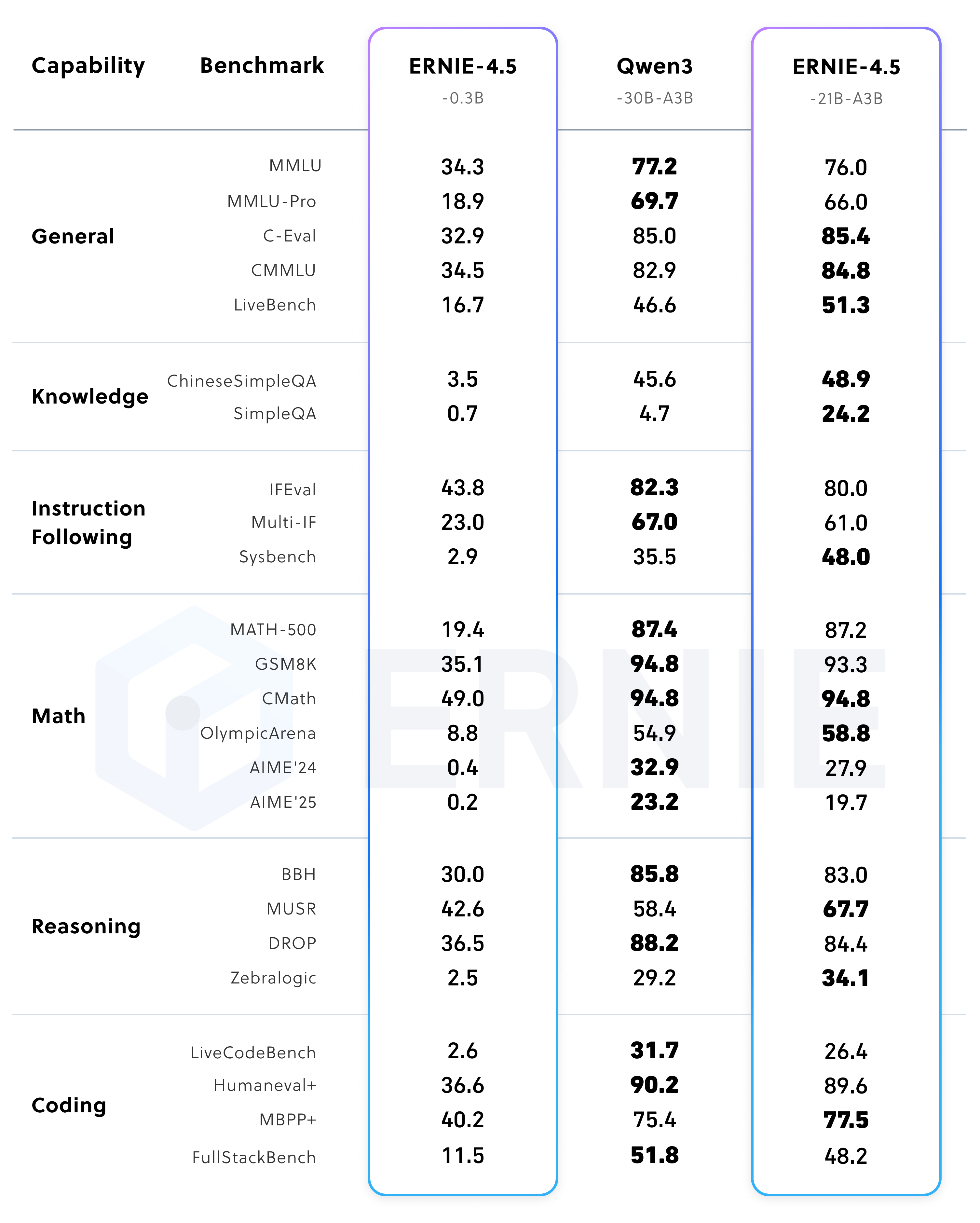

ERNIE-4.5-300B-A47B-Base 在 28 个基准测试中的 22 个超越了 DeepSeek-V3-671B-A37B-Base,在所有主要能力类别中均有领先的表现。相对于其他SOTA模型,在泛化能力、推理和知识密集型任务方面的显著提升。ERNIE-4.5-21B-A3B-Base 总参数量为 210 亿(约为 Qwen3-30B 的 70%),在包括 BBH 和 CMATH 在内的多个数学和推理基准上效果优于 Qwen3-30B-A3B-Base。尽管ERNIE-4.5-21B-A3B-Base 更小,但模型效果突出,实现了效果和效率的平衡。

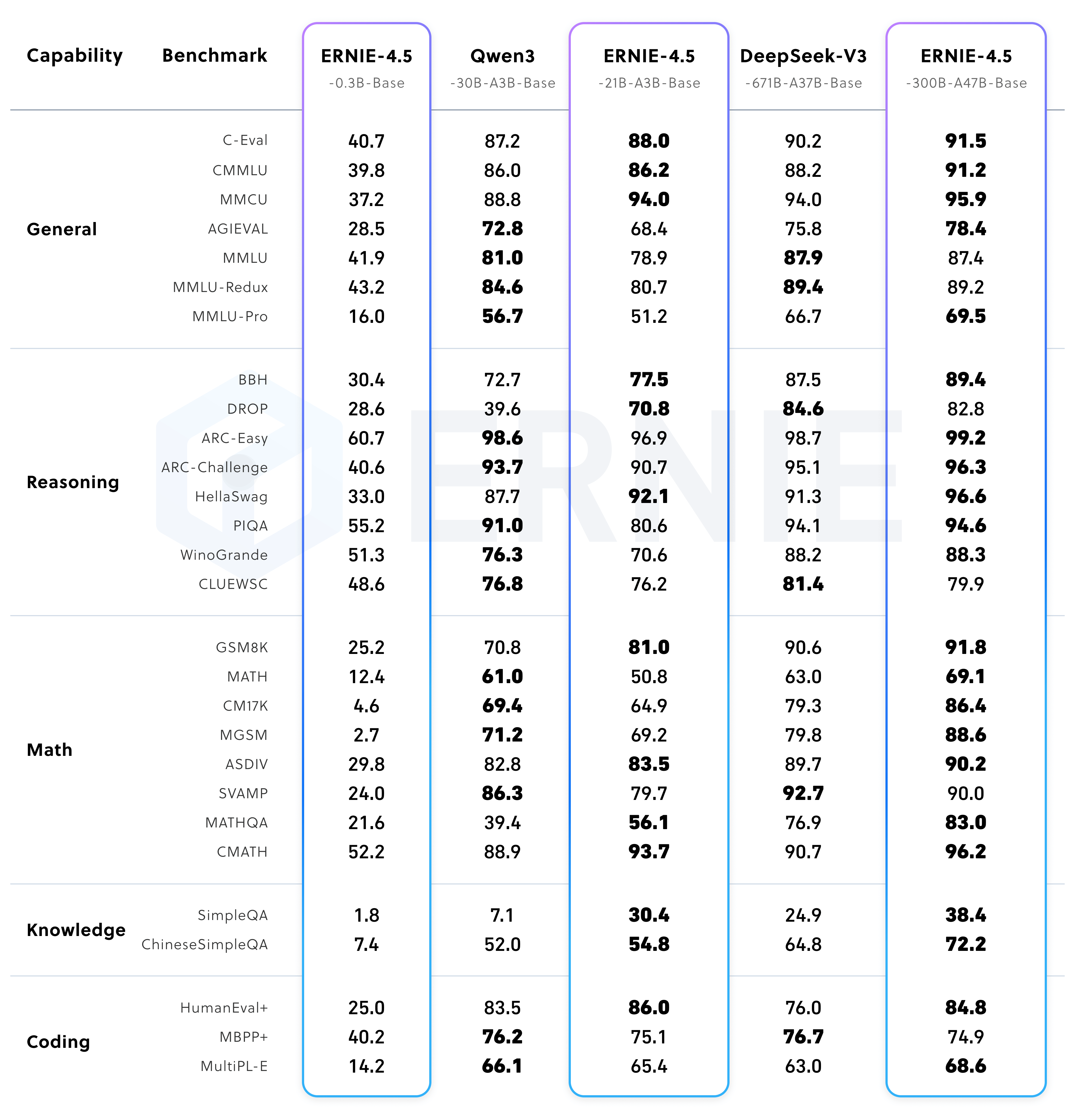

经过后训练的 ERNIE-4.5-300B-A47B 模型,在指令遵循和知识类任务方面表现出显著优势,其在 IFEval、Multi-IF、SimpleQA 和 ChineseSimpleQA 等基准测试中取得了业界领先的效果。轻量级模型 ERNIE-4.5-21B-A3B 尽管总参数量减少了约 30%,但与 Qwen3-30B-A3B 相比,仍取得了具有竞争力的性能。

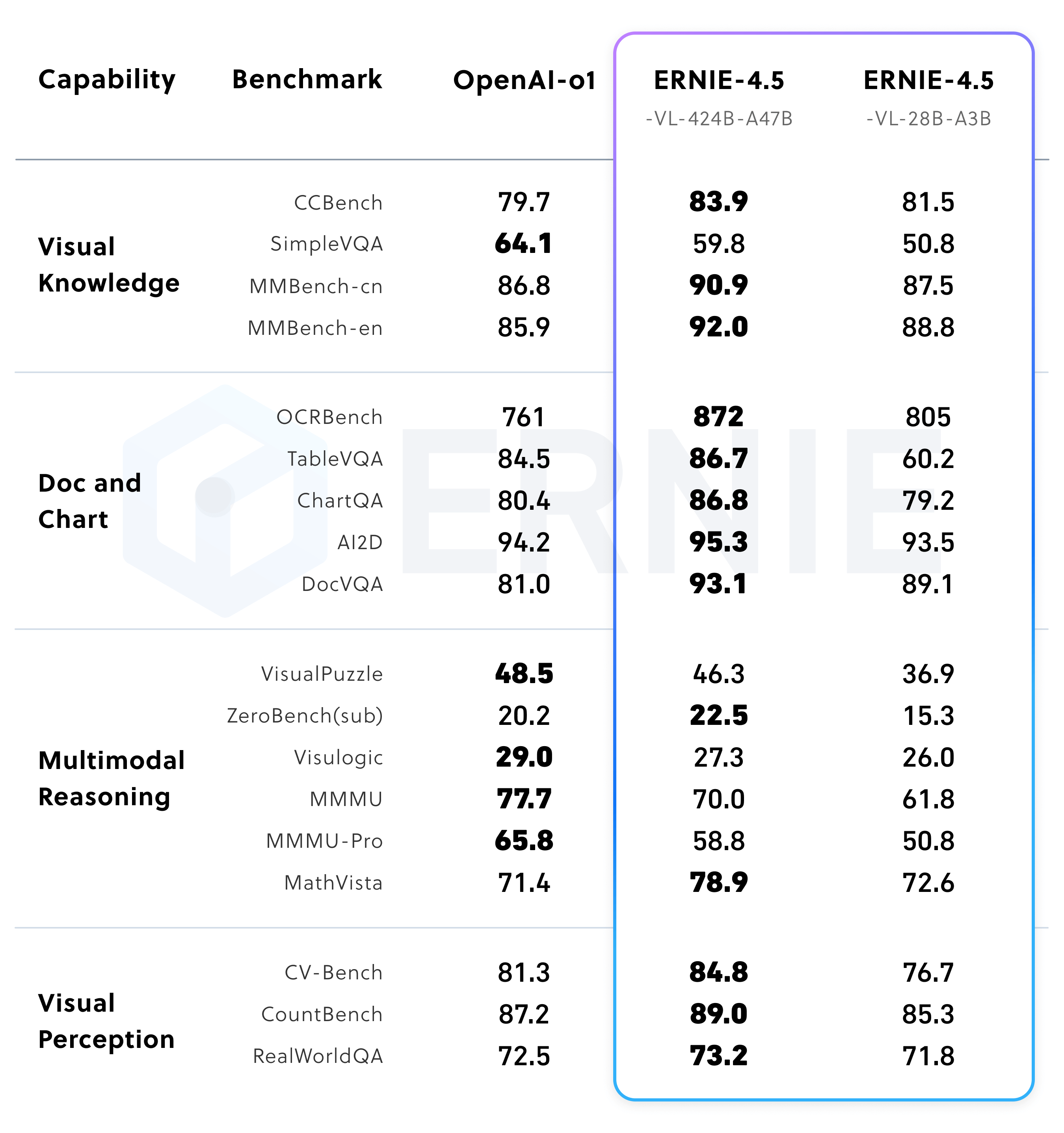

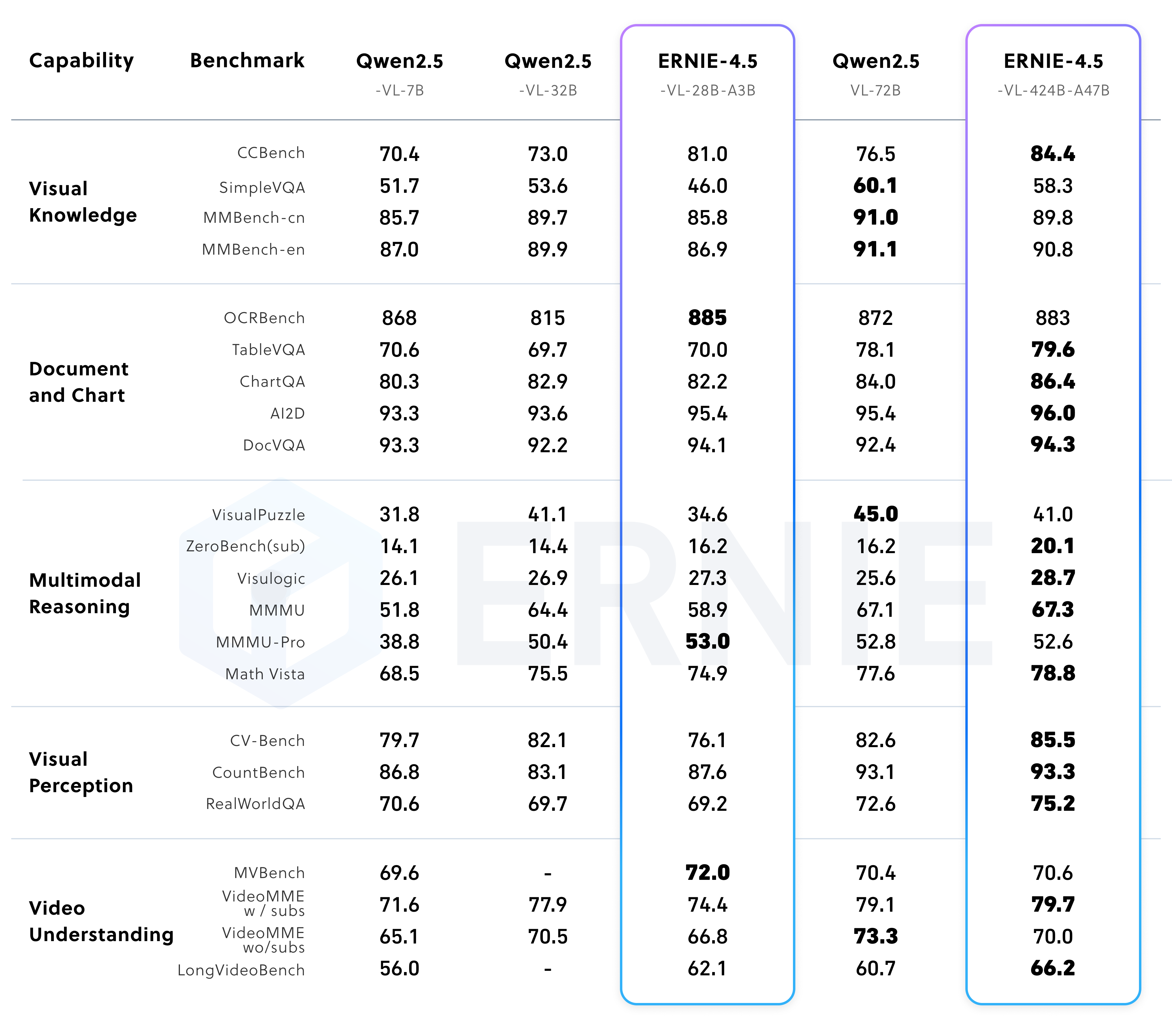

在非思考模式下,ERNIE-4.5-VL 在视觉感知、文档与图表理解以及视觉知识方面效果突出,在一系列基准测试中表现优异。在思考模式下,ERNIE-4.5-VL 不仅展现出比非思考模式更强的推理能力,还保留了非思考模式的强大感知能力。ERNIE-4.5-VL-424B-A47B 在各种多模态评估基准中均取得了突出效果。其思考模式在 MathVista、MMMU 和 VisualPuzzle 等高难度基准上具有明显优势,并在以感知为主的数据集(如 CV-Bench 和 RealWorldQA)上保持了不错的效果。尽管使用显著少的激活参数,轻量级视觉语言模型 ERNIE-4.5-28B-A3B 在大多数基准测试中,相较于 Qwen2.5-VL-7B 和 Qwen2.5-VL-32B,效果相当甚至更优。此外,文心4.5轻量级模型也同时支持思考和非思考两种模式,提供了与 ERNIE-4.5-VL-424B-A47B 一致的功能。

文心4.5预训练模型

ERNIE-4.5-300B-A47B 后训练模型

ERNIE-4.5-21B-A3B 后训练模型

多模态后训练模型(支持思考)

多模态后训练模型(关闭思考)

ERNIE 4.5使用入门

ERNIE 4.5模型使用飞桨(PaddlePaddle)框架进行训练。以下部分介绍了飞桨生态中用于精调和部署ERNIE 4.5模型的工具和资源。

对于使用 PyTorch 的开发者,ERNIE 4.5 模型也提供 PyTorch 格式的模型。

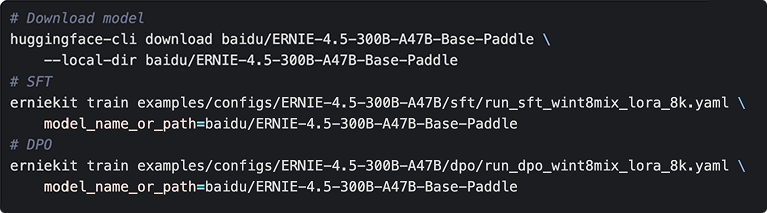

ERNIEKit:精调与对齐

ERNIEKit 是一个面向 ERNIE 4.5 的产业级开发套件。它提供了模型训练和压缩功能,包括预训练,SFT,LoRA, DPO,量化感知训练(QAT)和训练后量化(PTQ)等技术。

使用示例:

获取更详细的示例,请参阅 ERNIEKit 仓库。

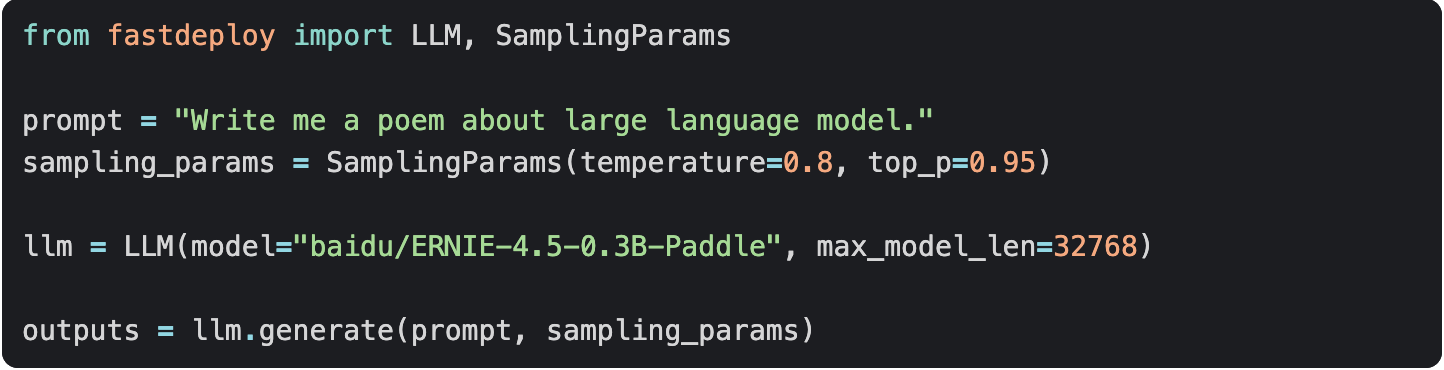

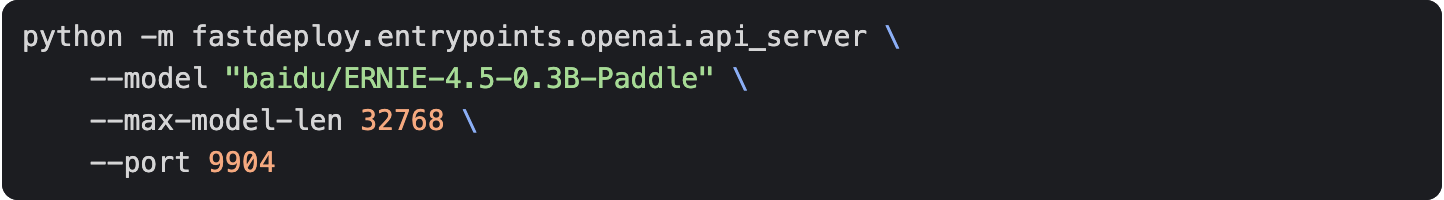

FastDeploy:高效模型部署

FastDeploy 是基于飞桨的大模型高效部署套件。提供了一行代码开箱即用的多硬件部署体验,使用接口兼容vLLM和OpenAI协议。针对 ERNIE 4.5 模型部署提供了多级负载均衡的多机PD分离部署产业级方案,支持丰富的低比特量化推理、上下文缓存、投机解码等加速技术。

本地推理示例:

服务部署示例:

一旦使用FastDeploy启动并运行服务,它提供了一个OpenAI兼容的API,允许轻松与现有工具和工作流集成。

有关详细文档、安装指南和高级配置选项,请参阅ERNIEKit和 FastDeploy 仓库。

许可证

ERNIE 4.5模型在Apache License 2.0许可下提供。该许可允许商业使用,但须遵守其条款和条件。

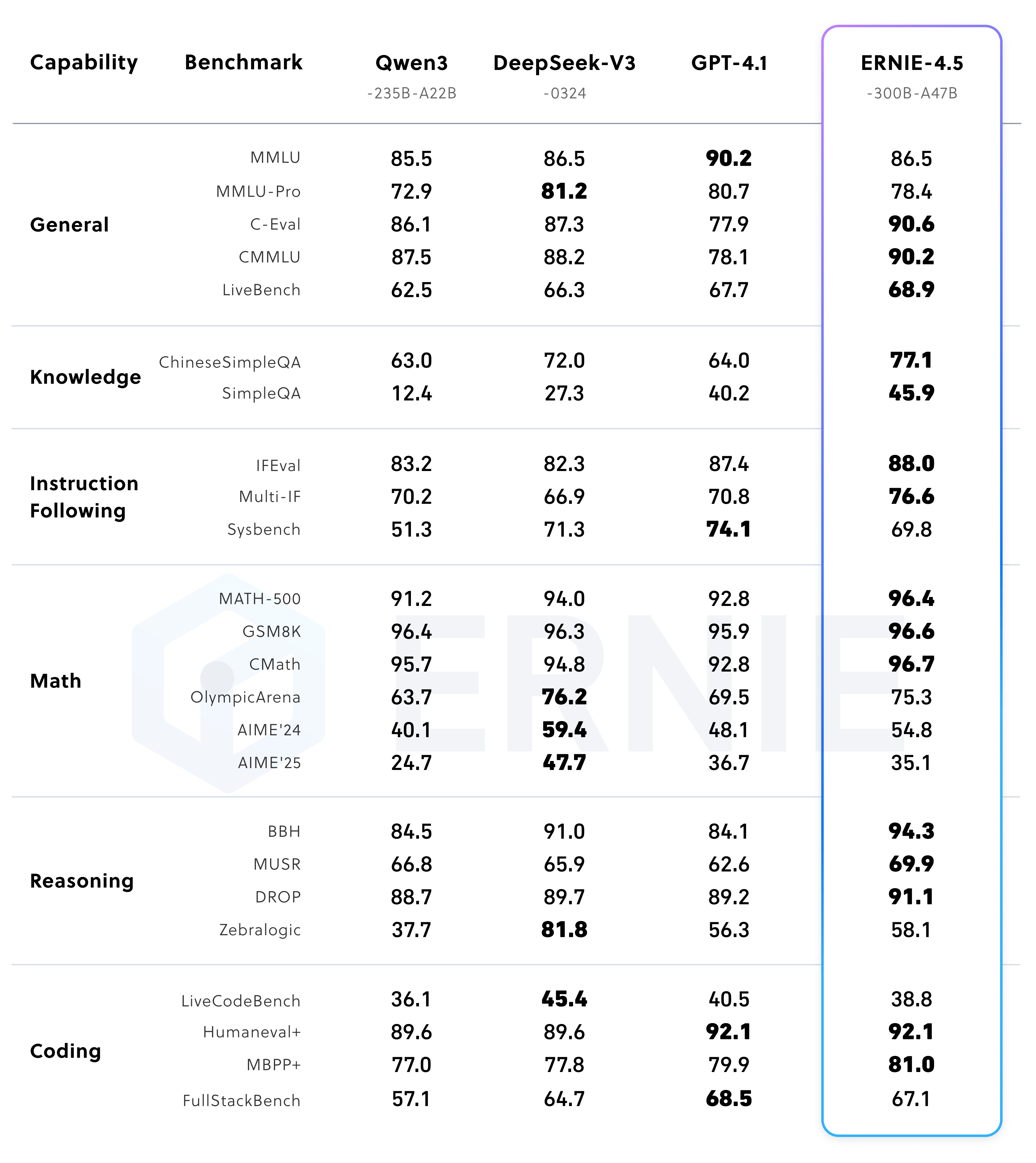

引用

如果您发现ERNIE 4.5对您有用或希望在您的项目中使用它,请引用我们的技术报告: